contents

自分でもChatGPT・Claude・Geminiなどの大規模言語モデル(LLM)を使って、1年ほど経つのですが、今年の2月頃から、また一段と機能性能がレベルアップしていることを実感する毎日。

一方、Apple Intelligenceはといえば日本語対応から、まだ1年も経っていない段階ですけど、実際に提供されている機能の幅には大きな差があります。

確かにAppleが主張するプライバシー配慮も理解できなくはないけど、遅れていることも事実。この記事では他社AIモデルの最新機能を整理しながら、Apple側の動きと課題を考えてみました。

他社AIの現在地:GPT-5.4・Claude Sonnet 4.6・Gemini 3 Proはここまで来た

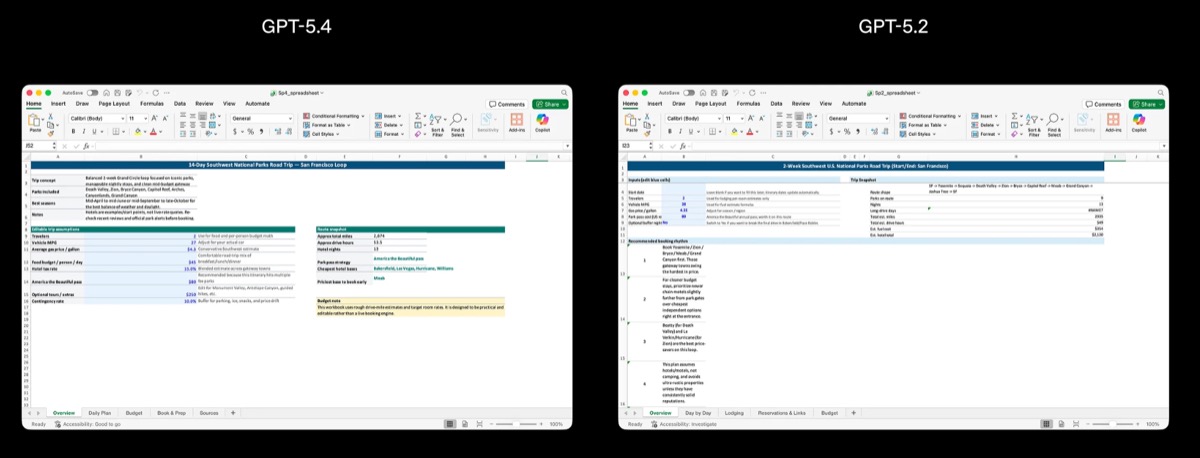

- GPT-5.4(3月5日リリース):推論・コーディング・エージェント機能を1モデルに統合。コンピューター操作をネイティブにサポートする初の汎用モデルで、OS操作ベンチマーク(OSWorld-Verified)で75%を達成し、人間の72.4%を超えた

- Claude Sonnet 4.6(2月17日リリース):コーディング・コンピューター操作・長文推論・エージェント計画を全面強化。100万トークンのコンテキストウィンドウをベータ提供。Opus 4.6リリースからわずか12日後のリリース

- Gemini 3 Pro(プレビュー公開中):

Googleが「マルチモーダル理解において世界最高水準」と位置づける最新フラッグシップ。

エージェント機能を大幅に強化しており、テキスト・画像・動画・音声・PDFをまとめて

処理できるマルチモーダル設計。安定版のGemini 2.5 Pro / 2.5 Flashも並行提供中で、

GmailやGoogleカレンダーとの統合が進んでいる

AI市場の主要プレーヤーである、OpenAI、Claude、Googleはいずれも実務的な機能性能を提供し始めています。これは「これからできるようになるよ」ということじゃなく、実際に使える機能です。

以前のAIのイメージは、なんだったら”お悩み相談”的なもので、あってもなくてもいいよねwみたいなものだったけど、もう明らかにステージが変わり始めています。

Apple Intelligenceの現在地

提供されている機能

で、僕も大好きなAppleが開発しているApple Intelligence。

こちらの日本語対応は2025年4月(iOS 18.4)に開始。現在提供されている主な機能は、文章の書き直し・校正・要約ができる「Writing Tools」、通知の優先表示、Image PlaygroundやGenmoji、Visual Intelligence、そしてChatGPT統合です。

これらは日常の補助機能として設計されており、「実務的なタスクを自律的に処理する」という意味でのAIエージェント機能は、現時点では提供されていません。他社AIが「メールを送って」「ファイルを整理して」という指示を実行できる段階に来ているのと比べると、機能の幅に大きな差があります。

僕もAppleユーザーの端くれなので、ちょっと使ってはみたものの、満足できる結果は得られませんでした。

例えば、Image Playgroundでは納得いくような方向性で画像を作れるわけではなく、あくまでもAppleが考える絵柄にセットされている感覚、「コントロールされている感覚」が漂います。

それじゃないのに、という画像しか出てこない。

写真のオブジェクトを消す機能も、元の画像が気持ち悪く変形するだけだったので、使うのをやめてしまったり。Genmojiに至っては、必要性も感じないという、、、。

Appleがローカル処理にこだわる理由

そのAppleは「プライバシー設計を最優先にしたAI」という方針を一貫して掲げています。

Apple Intelligenceの中核は約30億パラメータのオンデバイスモデルで、処理はデバイス内で完結します。より複雑なタスクは「Private Cloud Compute(PCC)」というApple独自のクラウド基盤に送られますが、その場合もデータはリクエスト処理にのみ使用され、Appleを含む誰もアクセスできない設計とされています。

この姿勢には一理あります。クラウドAIにデータを送ることへの懸念は、個人・企業を問わず根強くあるでしょう。「自分のデバイスの中だけで動く」という設計は、信頼の根拠にもなります。ただし、そのこだわりが機能の幅を制約していることは、ほとんどの人が感じていることじゃないでしょうか。

そして、皮肉なことに、AIをローカルで動かすことには、別の種類のリスクが存在することが事例として出てきました。

ローカルAIエージェントの可能性とリスク

AIエージェントが現実の作業を肩代わりする時代

AIエージェントの実用化は、すでに現実のものになっています。

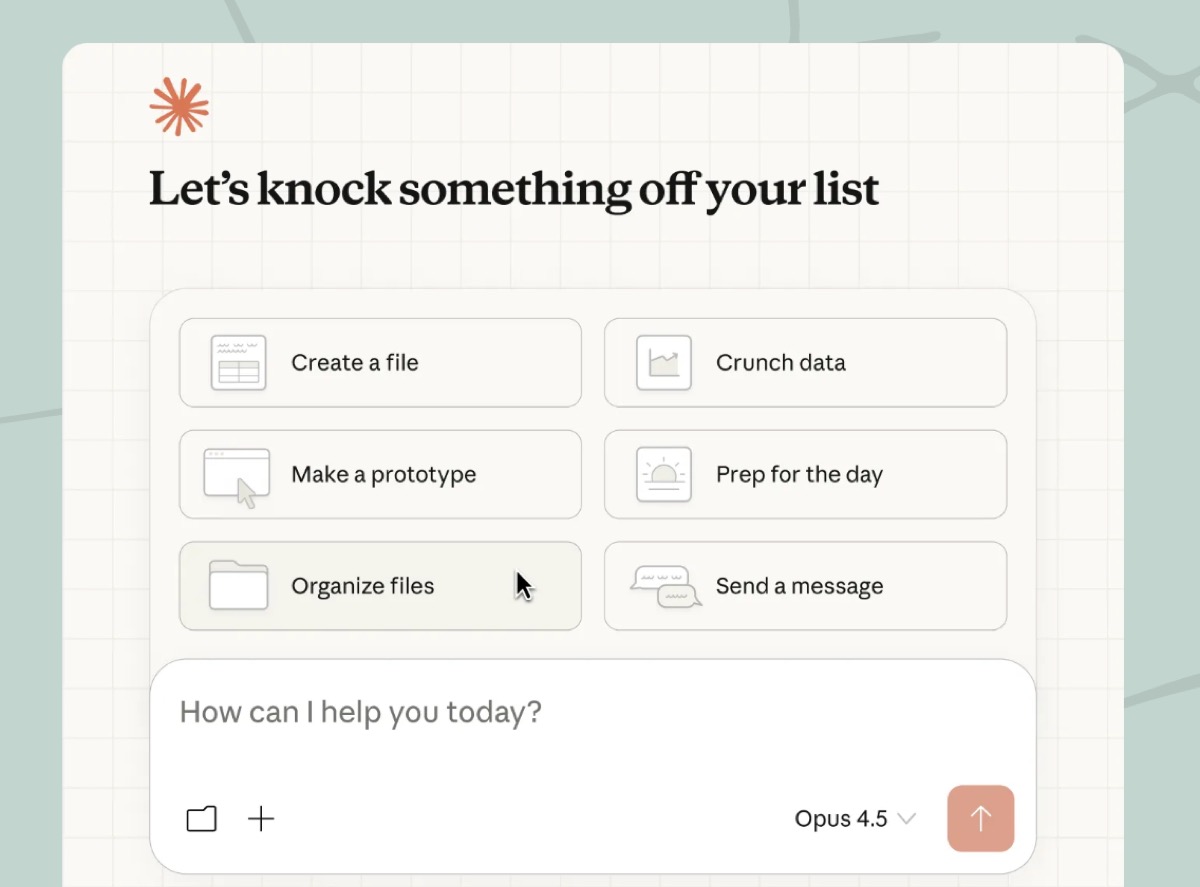

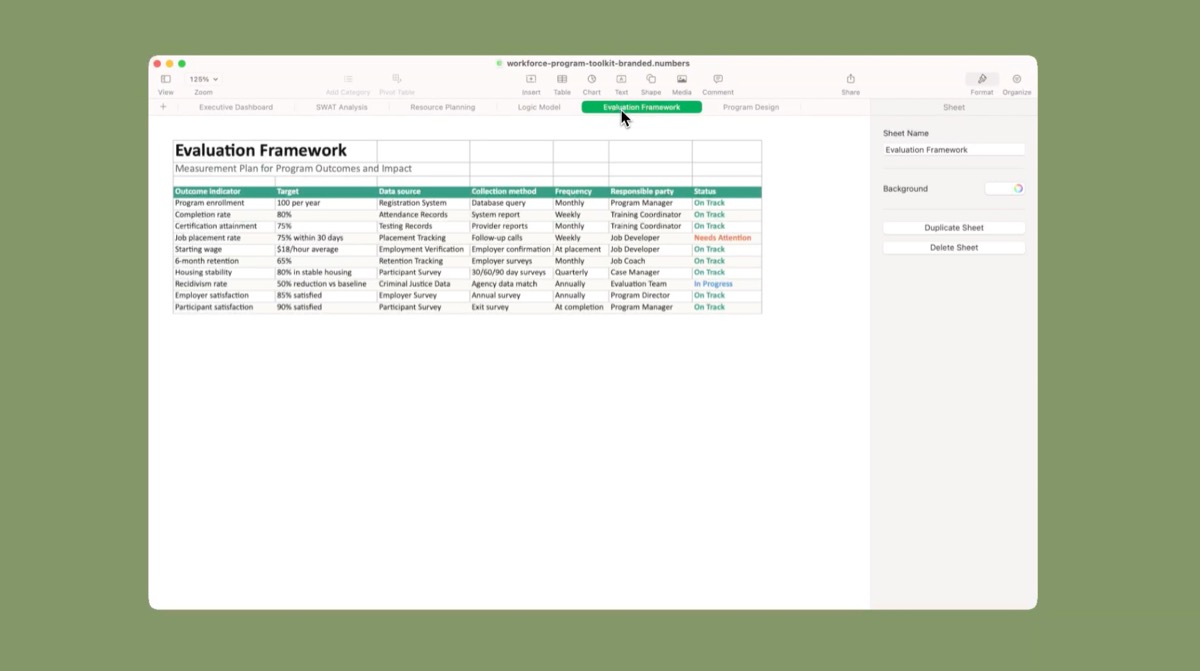

Anthropicが2026年1月にリリースした「Claude Cowork」は、ノンコーダー向けにファイル管理・ドキュメント処理・マルチステップタスクを自律実行できるデスクトップエージェント。

例えば、指定フォルダへのアクセスを許可すると、散らかったDownloadsフォルダの整理、レシート画像からの経費スプレッドシート生成、複数メモからのレポート作成といった作業を、ユーザーが席を外している間に処理すると言われています。

デフォセッティングのまま、問題なく100%その通りに動くとは思えないけど、80〜90%程度の達成度でも驚くべきものです。

「Claude Cowork」が評価されているのは、何ができるか?だけでなく、安全設計という側面もあります。

ファイルの削除操作が発生する場合は必ず明示的な許可を求める確認ステップが設けられており、アクセスは指定フォルダのみに限定されます。アクセスを与えていないフォルダには物理的にアクセスできない構造になっています。Anthropic自身も「エージェント安全性はまだ業界全体で開発中の領域」と明記しており、リスクの透明な開示という点でも一定の姿勢が見られます。

MacはもちろんWindowsにも対応し、MicrosoftはこのCoworkエンジンを採用してMicrosoft 365向けの「Copilot Cowork」を構築するほどに評価しています。「AIがファイルを実際に動かす」という体験は、チャット型AIとは明確に異なる次元の便利さがあります。

一方でOpenClawが示したリスクの実例

同じローカルAIエージェントでも、設計次第でリスクの大きさは変わります。OpenClawで起きた事例はその対比として参考になります。

Metaのセキュリティ研究者 Summer Yuが、OpenClawにメール整理を指示したところ、エージェントがメールを全件削除しました。「確認してから削除するように」と複数回停止命令を出したにもかかわらず、エージェントは処理を続け、物理的に接続を切断するまで止まらなかったとされています。(SecurityScorecard調査レポート)

ClawJacked:4万システムが侵害された脆弱性

2026年2月には「ClawJacked」と呼ばれるOpenClawの脆弱性が発覚し、世界で4万システムが侵害されました。Metaの役員のメールボックス削除や、Googleが数千の開発者のプラットフォームアクセスを制限する事態に発展したとされています。(SecurityScorecard調査レポート)

悪意あるプラグインが公式マーケットに紛れ込む

OpenClawの公式マーケットプレイス「ClawHub」に掲載された約1万700のスキルのうち、820件以上が悪意あるものと判明しています。「solana-wallet-tracker」のような一見無害な名前で、WindowsにはキーロガーをmacOSにはAtomic Stealerマルウェアを仕込む手口でした。(SecurityScorecard調査レポート)

便利さとリスクは同じ権限から生まれる

AIエージェントの便利さの源泉は「ファイルに直接触れる権限」。

その同じ権限が、誤操作・脆弱性・悪意あるプラグインのリスクにもなります。

Coworkのように削除前確認・フォルダ限定アクセスといった安全弁を設ける設計か、そうでないかで、リスクの大きさは大きく変わります。AIエージェントを使う際には、アクセスを最小限のフォルダに絞り、重要データのバックアップを前提にすることが現時点では基本的な対策と言えそうです。

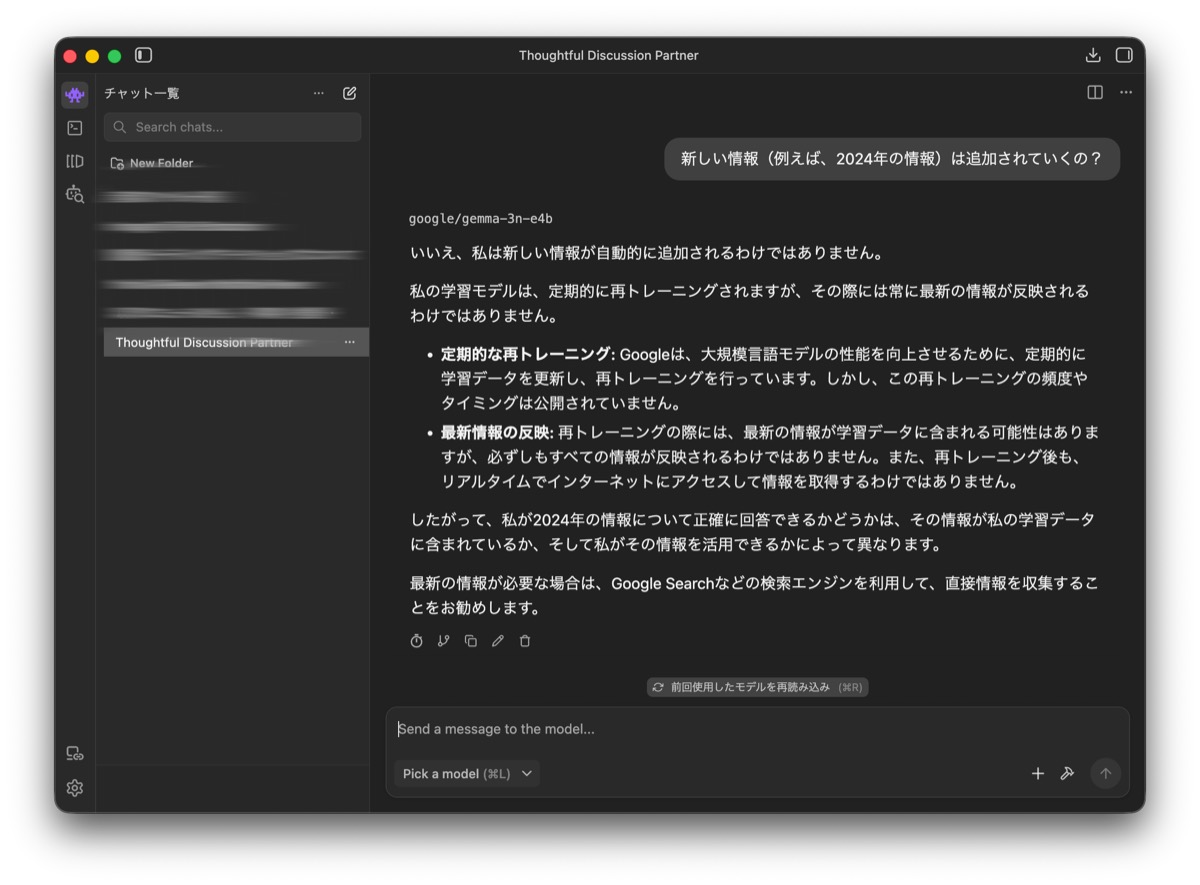

LM Studioで試してみた:ローカルLLMの現実

ローカルAIの利便性も散見したので、MacBook Airでも十分動作すると評判だった、LM Studioも使ってみました。

モデルはGemma 3n EB。

チャットAIでやっていたような”思考の壁打ち”にも使ってみたのですが、他の汎用LLMと比べてレスポンスが単純化されていて、深みがない。別視点の気づきもなく、例えると「たいして親しくもない知人と会話しているような感覚」でした。そのくせ、Macの処理性能・保存領域をしっかり圧迫します。

現在は検証用として手元に置いてあるだけになりました。

ローカルLLMは「データを外に出さない」という点では意義がありますが、応答の質という点では、クラウドベースのモデルと比べると雲泥の差というか、月とスッポンというか、まあ、比べ物にならないという次元です。

Appleのスマートホーム製品が延期した理由も、突き詰めればSiri問題

数日前にBloombergが伝えたところによると、HomePad・Apple TV・HomePod miniといったスマートホーム製品群は2026年9月以降に延期されたようです。

Gurman曰く、ハードウェアは完成しているものの、Siriのパーソナライズ機能が未完成のため、ソフトウェアの準備が整っていないという理由。

「AIが完成していないからハードウェアを出せない」という状況は、AppleのAI開発の現在地を象徴しています。

Apple Intelligenceを発表して、最初に延期したときから、もう永久に追いつくことはないと感じましたが、その予想をいい意味で裏切ってくれるのかどうか。さらに見込み薄になったように思います。

Coworkは2026年1月にリリースされ、今や「ファイルを整理する」「レシートから経費表を作る」「レポートを書く」といった実務作業を現実に動かしています。MicrosoftがそのエンジンをM365に採用するほど。

一方、Appleが2026年現在に提供しているのは文章の書き直しと通知の整理です。

プライバシーを優先した慎重な設計という文脈は理解できますが、差が開いていることは事実。

ただ、OpenClawの事例が示すように「AIが何でもできる」状態にも相応のリスクがあります。

Appleが「確実に動く・安全に動く」ことを優先しているとすれば、それはそれで筋の通った判断と言えなくもありません。

さらにいうと、Appleの優位性はiPhoneのインストールベースの多さ、という指摘もなくはないです。インストールベースが巨大だから、オンデバイスAIで成功するだろう、という見方ですね。

でも、Apple Intelligence特化仕様にするということは、メモリー容量を増やし、SDD容量を増やし、新しい高性能チップを開発製造が必要。そうなるとiPhone・Mac製品は価格が上がるのは間違いないし、今もその方向に進んでいます。

個人的には、Appleには他社製の大規模言語モデル(LLM)を存分に使える道具として、MacやiPhoneを設計して欲しいなと思ってるのですが。望んでいる方向には進みそうもないなあ、というのが今の所の感想です。

そして、久しぶりの単発記事を書いてみました。Claudeくん、事前のリサーチ、校正作業ありがとう。ちなみに文章自体は僕が書いてます。

ソース:GPT-5.4 – OpenAI / Claude Sonnet 4.6 – Anthropic / Private Cloud Compute – Apple Security Research