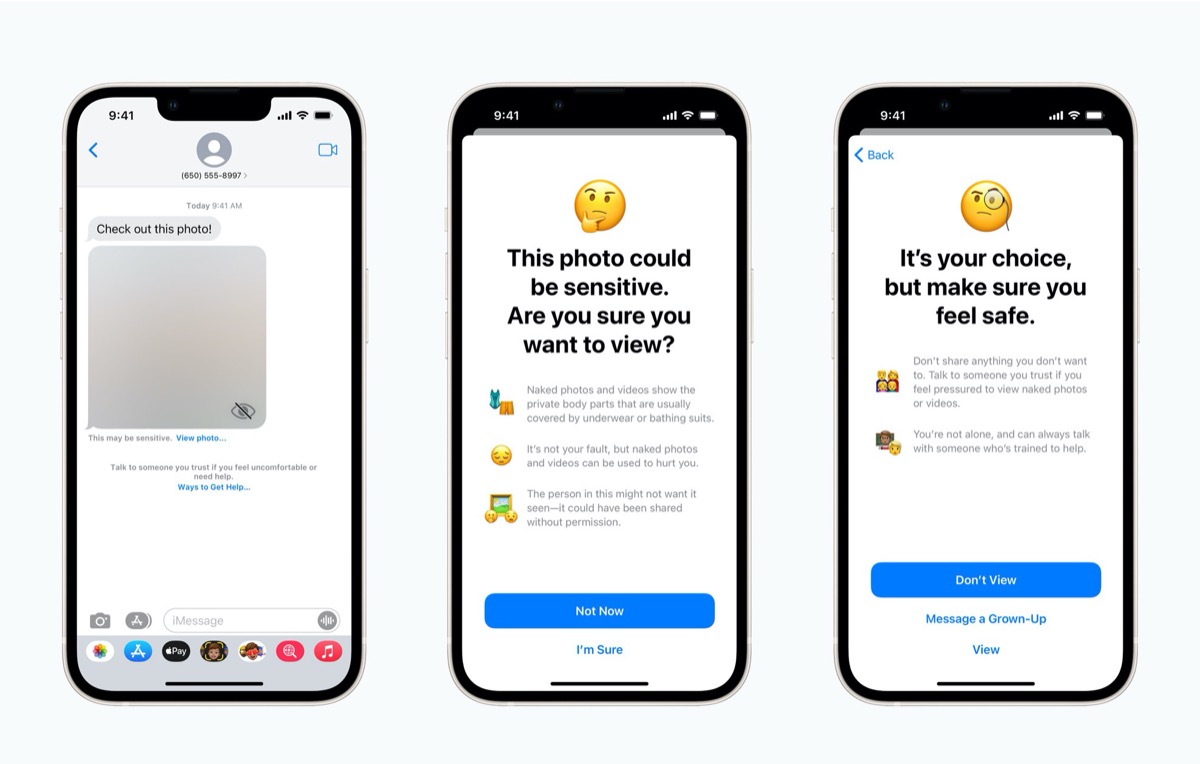

今年8月に発表され、「バックドアではないか」との批判が各所で出て、フェデリギ氏が弁明していたCSAM検出機能ですが、Appleのウェブサイト「Child Safety – Apple」にあった説明から該当箇所を”静かに”削除していることがわかりました。

アップルのウェブサイトでは、以前、メッセージでのコミュニケーション・セーフティ機能とともに、iPhoneの児童性的虐待資料のスキャン計画や、誰かがCSAMを検索した際の警告について説明されていました。しかし、現在ではCSAMスキャンに関する項目は無くなっています。

先週の金曜日にはウェブサイトに存在していましたが、月曜日にiOS 15.2をリリースした後で削除されたようです。

先週まで表示されていた内容があるアーカイブはこちら。>「Child Safety – Apple」

一部の人々は、これはAppleが計画を放棄したことを意味すると推測していますが、この機能の搭載を延期し続けることもあり得ると考える人もいます。

延期し続けることで、CSAM機能はバックドアだと主張するセキュリティ団体などの人たちからの批判を避けると同時に、機能そのものは搭載を考えていたという事実があることで、児童保護団体から批判が起こりそうになっても、「追加のセーフガードを開発する努力を続けている」と表明することができます。

ただ、この方法は永遠に使うことはできないため、例えば、次のiOS 16へのメジャーアップグレードまでには機能を追加するか、撤廃するかを選択しなくてはいけなくなるかもしれません。

ユーザーとしては、引き続き、これらの動きを注視するとともに、セキュリティに懸念を感じるのであれば写真のバックアップをiCloudでは行わずに、他の手段でバックアップと同期を行う手段を用意する必要があると思います。